一、基础信息配置

| 维度 | 内容 |

|---|---|

| 文章标题 | 腾讯AI个人助手核心技术拆解:Agent从概念到落地 |

| 发布时间 | 2026年4月10日(北京时间) |

| 目标读者 | 技术入门/进阶学习者、在校学生、面试备考者、相关技术栈开发工程师 |

| 文章定位 | 技术科普 + 原理讲解 + 代码示例 + 面试要点 |

| 写作风格 | 条理清晰、由浅入深、语言通俗、重点突出 |

二、整体结构

开篇引入

2026年被称为“AI Agent爆发元年”。腾讯在2026年3月正式推出Agent产品全景图,面向个人用户的QClaw进入全量公测-15。腾讯集团高级执行副总裁汤道生指出:人工智能的应用范式正从“Chatbot”向“AI Agent”跃迁-11。

但很多学习者在接触Agent时面临共同痛点:只会用、不懂原理、概念混淆、面试答不出。本文将系统拆解腾讯AI个人助手背后的核心技术——从大模型与Agent的本质区别,到底层架构与代码实现,再到面试高频考点,帮读者建立完整知识链路。

一、痛点切入:为什么需要AI Agent?

传统大语言模型(LLM)的核心问题是:它只会“说”,不会“做”。面对“帮我把桌面报表求和并传给我”这类任务,传统LLM只能给出操作步骤的文字说明,无法真正执行-3。这就好比一个“博学的智者”被困在书房里——知识丰富,但没有手脚去行动-49。

传统方式的问题:

信息孤岛:模型无法访问文件系统、浏览器、办公软件

无状态执行:每次对话都是独立的,无法记住之前的操作结果

耦合度高:每增加一个新能力,都需要重新开发集成

这些痛点催生了AI Agent——一个配备“手脚”的智能执行者,能够理解指令、自主决策、调用工具、交付成果。

二、核心概念讲解:AI Agent

定义:AI Agent(人工智能智能体)是一种能感知环境、自主决策并采取行动以实现目标的智能实体。与普通程序不同,它具有一定的自主性和适应性-80。

核心公式:

Agent = LLM + Planning(规划) + Memory(记忆) + Tool Use(工具使用)其中:

Planning:将复杂目标拆解为可执行的子任务

Memory:短期记忆维护多轮对话状态,长期记忆通过RAG(检索增强生成)沉淀知识

Tool Use:通过函数调用调用API,让Agent与外部世界交互-49

生活化类比:LLM像一位学识渊博的大学教授——能解答任何学术问题,但不会帮你打开电脑整理桌面。Agent像一位私人助理——不仅能听懂你的需求,还会自己去操作电脑、调用软件、交付结果。

三、关联概念讲解:LLM vs Agent

LLM(大语言模型,Large Language Model) 是基于Transformer架构的深度学习模型,通过学习海量文本数据掌握人类语言的规律。以腾讯混元大模型为例,它采用MoE(混合专家模型,Mixture of Experts)架构,具备万亿级参数规模-23。

LLM与Agent的对比:

| 维度 | LLM | Agent |

|---|---|---|

| 交互方式 | 单轮/多轮对话问答 | 任务驱动的自主执行 |

| 能力边界 | 生成文本、回答问题 | 调用工具、操作软件、交付成果 |

| 状态管理 | 对话历史 | 任务上下文 + 长期记忆 |

| 典型场景 | 写文案、翻译、代码补全 | 自动整理文件、抓取网页、远程控制电脑 |

一句话记住:LLM是“会说的学霸”,Agent是“会干的助理”——Agent让AI有了手脚。

四、概念关系与区别总结

逻辑关系:LLM是Agent的“大脑”,Agent在LLM之上构建了执行体系。

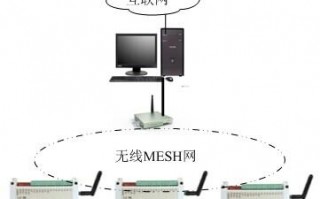

腾讯QClaw的技术架构清晰体现了这一关系:QClaw作为本地AI智能体,核心价值在于充当 “物理网关” ——将LLM的推理能力转化为对本地操作系统、文件系统及应用接口的真实执行动作-95。

底层设计实现了 “大脑”与“躯干”的解耦:

大脑(LLM) :负责语义解析与任务拆解,支持混元、DeepSeek、Kimi等主流模型-12

躯干(OpenClaw Gateway) :Python守护进程,在本地监听端口,接收大脑传来的指令,根据权限执行动作-95

这种架构意味着模型本身不直接接触你的系统,而是通过Agent中转执行,既保证了灵活性,也兼顾了安全性。

五、代码/流程示例演示

5.1 Agent核心流程示例(伪代码)

用户输入:"帮我把桌面的report.xlsx求和并传给我" → 1. LLM意图解析:识别到需要执行"文件操作" + "Excel计算" → 2. 任务规划:拆解为 打开Excel→读取数据→求和→保存结果→发送文件 → 3. 工具调度:调用文件系统API + Excel处理脚本 + 微信文件传输接口 → 4. 执行与反馈:执行每一步,将结果返回用户

5.2 实际代码示例——调用混元大模型API

以下是一个通过腾讯混元API完成对话的基础调用示例:

腾讯混元大模型API调用示例(Python) 前置条件:已获取SecretId和SecretKey,已开通混元服务 import json from tencentcloud.common import credential from tencentcloud.hunyuan.v20230901 import hunyuan_client, models 1. 初始化认证 cred = credential.Credential("your-secret-id", "your-secret-key") client = hunyuan_client.HunyuanClient(cred, "ap-guangzhou") 2. 构建请求 req = models.ChatCompletionsRequest() req.Model = "hunyuan-lite" req.Messages = [ {"Role": "user", "Content": "请帮我总结今天的会议要点"} ] 3. 调用API resp = client.ChatCompletions(req) print(resp.Choices[0].Message.Content)

注:实际调用需使用腾讯云SDK,签名机制采用TC3-HMAC-SHA256-。

5.3 QClaw实际执行示例

用户在微信发送指令:“帮我把桌面报表求和并传给我”,QClaw的自动化流程为:自动扫描本地文件 → 打开Excel/调用API读取 → 执行求和计算 → 将结果通过微信小程序回传用户-3。

5.4 对比:传统方式 vs Agent方式

| 对比维度 | 传统方式 | Agent方式 |

|---|---|---|

| 用户操作 | 手动打开Excel→输入公式→保存→打开微信→上传 | 一句话指令 |

| 执行时间 | 约2-3分钟(含操作) | 约10-30秒 |

| 技术门槛 | 需要知道Excel操作 | 零门槛自然语言 |

| 跨应用协同 | 手动复制粘贴 | 自动联动 |

六、底层原理/技术支撑

6.1 Agent的技术支柱

Agent之所以能够“动起来”,依赖三个底层技术支撑:

Function Calling(函数调用) :大模型被训练为在特定场景下输出结构化指令(而非自然语言),告诉系统“应该调用哪个工具、传什么参数”

RAG(检索增强生成,Retrieval-Augmented Generation) :让Agent能够从外部知识库检索信息,突破大模型训练数据的时效性限制-80

沙箱执行环境:Agent执行高风险操作时,在隔离的安全环境中运行,防止对真实系统造成破坏

6.2 腾讯的工程底座

腾讯云在2026年3月首次发布Agent产品全景图,围绕五个层面构建完整体系-15:

Agent基础设施层:企业级Agent的操作系统,提供技术底座与治理平台

模型服务层:MaaS平台升级为TokenHub,提供全栈模型供给

技能生态层:开放自研技能与开源SkillsHub,覆盖5000+预置技能

AI应用层:面向个人提效、企业营销、研发等场景的产品矩阵

安全层:贯穿全链路的安全保障方案

汤道生指出:“AI落地不只是一道算法题,更是一道工程题。” 当模型能力逐渐趋同,真正拉开差距的是围绕模型构建的Harness工程能力——包括工具调用、上下文管理、长记忆与工作流设计-11。

6.3 QClaw V2最新进展

2026年4月9日,腾讯云正式发布QClaw V2大版本,聚焦解决“记不住、乱回复、难联动、不安全”四大痛点,引入多Agent并行处理机制(最多同时3个Agent协同),推出智能连接器实现跨应用自动化,并内置沙箱化安全防护-93。

七、高频面试题与参考答案

面试题1:请解释LLM和Agent的核心区别。

参考答案:LLM(大语言模型)是被动的文本生成模型,核心能力是“预测下一个词”,只能完成问答交互。Agent则是在LLM之上构建的自主执行系统,具备规划能力、记忆管理和工具调用能力,能够将用户意图转化为实际行动。核心区别在于:LLM会“说”,Agent会“做”。从公式来看,Agent = LLM + Planning + Memory + Tool Use。

面试题2:Agent的核心架构包含哪些模块?各自的职责是什么?

参考答案:Agent的核心架构通常包含四层:①LLM层(大脑):负责语义理解与推理决策;②规划层(Planning):将复杂任务分解为可执行的子任务序列;③记忆层(Memory):短期记忆维护对话状态,长期记忆通过RAG实现知识沉淀;④工具层(Tool Use):通过Function Calling调用外部API、文件系统或应用接口。这四层协作实现“思考→规划→记忆→执行”的闭环。

面试题3:Agent开发中常见的失败场景有哪些?如何解决?

参考答案:主要有三类失败场景:①工具调用失败(参数格式错误、API超时):需建立参数校验层和重试机制;②上下文溢出(对话过长导致记忆丢失):采用上下文压缩、摘要提取或滑动窗口策略;③目标漂移(Agent偏离原始任务):每步执行后做目标对齐,引入反思机制和重新规划逻辑。实际工程中还需要设置执行超时限制和人工兜底。

面试题4:什么是ReAct模式?它和CoT(思维链)有什么区别?

参考答案:ReAct(Reasoning + Acting)是Agent的经典设计模式,它将“推理”和“行动”交替进行——模型每思考一步就执行一步,根据执行结果决定下一步。CoT(思维链)只进行推理,不涉及实际执行动作。ReAct适合需要与环境交互的复杂任务,而CoT更适合纯文本推理场景。实际工程中常将两者结合使用。

八、结尾总结

本文核心知识点回顾:

LLM vs Agent:LLM是“大脑”(会思考),Agent是“完整的人”(会思考+会行动)

核心公式:Agent = LLM + Planning + Memory + Tool Use

技术支撑:Function Calling提供“手脚指令”,RAG提供“外部知识”,沙箱保障“安全执行”

腾讯实践:QClaw基于OpenClaw架构,实现微信→PC的远程自动化,支持5000+Skills

面试重点:理解LLM与Agent的本质区别,掌握ReAct等设计模式,熟悉工程化挑战与解决方案

重点提示:不要将Agent简单理解为“大模型加一层包装”。真正的Agent核心在于规划与执行的闭环能力——能否自主分解任务、能否正确调用工具、能否在失败后自我修正。这些能力决定了一个Agent是否“好用”。

进阶预告:下一篇将深入讲解 Function Calling的技术原理与实现,包括工具描述规范、参数校验机制和多工具协同调度,敬请期待!

参考资料来源:腾讯云官方发布(2026年3-4月)、极客公园、IT之家、阿里云开发者社区等。数据截至2026年4月10日。