2026年,人工智能正经历从“对话框时代”到“智能体时代”的范式转移。吕布AI助手作为具备自主规划、工具调用与长期记忆能力的智能体产品,成为这一轮技术浪潮的典型代表。本文深入拆解吕布AI助手背后的AI智能体(AI Agent)核心技术架构,涵盖大模型与智能体的概念辨析、底层原理、代码示例与高频面试题,助你从入门到实战,建立完整的知识链路。

【系列导读】 本文是《2026智能体实战系列》第1篇。后续将陆续推出:多智能体协作架构、记忆系统优化实战、工具调用安全机制等进阶内容,敬请关注。

一、痛点切入:为什么我们需要AI智能体?

1.1 传统AI助手的典型代码实现

先看一段传统AI助手的简化实现代码:

传统规则式AI助手:只会执行固定指令 class TraditionalAIAssistant: def __init__(self): self.commands = { "查天气": self.get_weather, "定闹钟": self.set_alarm, "播放音乐": self.play_music } def process(self, user_input): 只能匹配预设关键词,超出范围即失败 for keyword, func in self.commands.items(): if keyword in user_input: return func(user_input) return "抱歉,我不明白你在说什么" 遇到复杂任务直接卡壳 def get_weather(self, _): return "今天晴,25度" 硬编码,不会灵活获取 def set_alarm(self, _): return "闹钟已设置" 无法理解“明早8点”这类相对时间 def play_music(self, _): return "播放默认歌单" 不能根据心情推荐

1.2 传统方案的三大痛点

上述代码暴露了传统AI助手的核心局限:

| 痛点维度 | 具体表现 | 影响 |

|---|---|---|

| 缺乏理解能力 | 只能匹配关键词,无法理解模糊意图。例如“有点闷,想放松一下”这种指令,传统助手无法判断是要开窗、开空调还是播放轻音乐 | 适用场景极其有限 |

| 无自主行动力 | 只能输出文本或调用硬编码函数,不能主动规划多步骤任务。比如“帮我安排一次周末旅行”,传统助手无法分解为“查机票→订酒店→安排行程”的完整链路-2 | 无法处理复杂任务 |

| 没有记忆机制 | 每次对话都是独立的,记不住用户偏好。你告诉过它“怕冷、喜欢靠窗座位”,下次订票时它完全忘记 | 体验割裂,重复问询 |

这就是吕布AI助手等新一代智能体产品要解决的核心问题:如何让AI从“只会回答”变成“会做事”。

二、核心概念:大语言模型(LLM)

2.1 定义

大语言模型(Large Language Model,LLM)——指基于Transformer架构、在海量文本数据上预训练的大规模神经网络模型,具备语言理解、文本生成与逻辑推理能力。

一句话理解:LLM就像一个读过万卷书的大脑,知识储备丰富,能听懂人话,但它没有手和脚,无法自己动手做事。

2.2 LLM能做什么、不能做什么

┌─────────────────────────────────────────────────────┐ │ LLM 擅长(强项) │ ├─────────────────────────────────────────────────────┤ │ ✅ 语言理解:听懂“明早8点叫我起床”中的“8点”“起床” │ │ ✅ 文本生成:写邮件、写摘要、写代码 │ │ ✅ 逻辑推理:通过思维链(CoT)推导结论[reference:1] │ ├─────────────────────────────────────────────────────┤ │ LLM 不擅长(弱项) │ ├─────────────────────────────────────────────────────┤ │ ❌ 主动交互:需要你问一句它才答一句 │ │ ❌ 工具调用:不会主动打开日历、发送邮件、操作软件 │ │ ❌ 长期记忆:每次对话都是新的,记不住你讨厌香菜 │ └─────────────────────────────────────────────────────┘

打个比方:LLM是“超级大脑”,吕布AI助手则是给这个大脑装上了五官、手脚与记忆的“数字员工”——能感知环境、拆解任务、执行动作-2。

三、核心概念:AI智能体(AI Agent)

3.1 定义

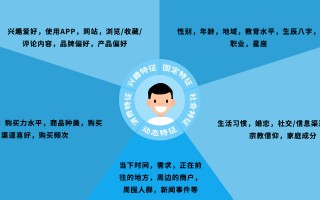

AI智能体(AI Agent,也称AI代理)——指以大语言模型为核心驱动力,具备自主规划、记忆存储与工具调用能力的智能实体,能够在数字环境中感知信息、制定计划、执行行动并持续迭代优化。

3.2 核心公式

业界公认的智能体能力公式-25:

Agent = LLM + Planning + Memory + Tool Use即:AI智能体 = 大语言模型 + 规划能力 + 记忆系统 + 工具调用

3.3 四大核心模块

一个完整的AI智能体由以下模块组成-2-40:

| 模块 | 功能 | 类比 | 在吕布AI助手中的体现 |

|---|---|---|---|

| 感知模块(Perception) | 接收并理解用户的多模态输入(文字/语音/图像) | 五官 | 通过语音唤醒“Hi,吕布”,实时理解游戏战况-16 |

| 决策/规划模块(Planning) | 将模糊目标拆解为可执行的子任务序列 | 中枢神经 | 接到“帮我分析这把对局”时,自动拆解为“查看数据→分析优劣势→给出建议” |

| 行动模块(Action/Tool Use) | 调用外部工具/API执行具体操作 | 手脚 | 自动查询攻略、生成赛后视频、同步音乐歌单-16 |

| 记忆模块(Memory) | 短期存储会话上下文,长期存储用户偏好 | 笔记本 | 记住用户常玩的英雄、喜欢的音乐类型,下次自动推荐 |

四、概念关系梳理:LLM 与 AI Agent 的区别

这是面试中最高频的考点,务必清晰记忆。

4.1 一句话概括

LLM是智能体的“大脑”,AI Agent是拥有大脑、五官、手脚和记忆的“完整数字员工”。

4.2 对比表格(面试必背)

| 对比维度 | 大语言模型(LLM) | AI智能体(AI Agent) |

|---|---|---|

| 本质 | 单一体——语言模型 | 复合体——模型+规划+记忆+工具 |

| 交互模式 | 被动响应:你问→它答 | 主动行动:感知→规划→执行→反馈-2 |

| 能力边界 | 只能输出文本 | 能操作软件、调用API、控制设备 |

| 任务类型 | 单步任务(回答问题、写文案) | 多步复杂任务(安排旅行、部署博客) |

| 记忆 | 有限上下文窗口(约128K tokens) | 短期+长期记忆,跨会话持久化-25 |

| 典型代表 | GPT-4、DeepSeek、Claude | 吕布AI助手、Manus、OpenClaw-44 |

4.3 关系图示

┌─────────────────────────────────────────────────────────────┐ │ AI智能体(完整数字员工) │ │ ┌─────────┐ ┌─────────┐ ┌─────────┐ ┌─────────┐ │ │ │ 感知模块 │→│ 规划 │→│ 行动 │→│ 记忆 │ │ │ │ (五官) │ │(大脑) │ │(手脚) │ │(笔记本)│ │ │ └─────────┘ └────┬────┘ └─────────┘ └─────────┘ │ │ │ │ │ ▼ │ │ ┌─────────────┐ │ │ │ LLM内核 │ ← 提供理解、推理、生成能力 │ │ └─────────────┘ │ └─────────────────────────────────────────────────────────────┘

记忆口诀:LLM会“想”,Agent会“想+做+记”。

五、代码/流程示例:从零实现一个极简智能体

下面展示如何用Python搭建一个具备“规划+记忆+工具调用”能力的极简智能体,直观对比传统方案的改进效果。

import json from typing import Dict, List from datetime import datetime ---------- 1. 定义工具库(相当于Agent的“工具箱”)---------- class ToolLibrary: """Agent可调用的外部工具集合""" @staticmethod def get_weather(city: str) -> str: """查天气工具""" 实际场景应调用真实天气API weather_db = {"北京": "晴, 22°C", "上海": "多云, 24°C", "广州": "小雨, 28°C"} return weather_db.get(city, f"{city}天气数据暂不可用") @staticmethod def send_email(to: str, subject: str, content: str) -> str: """发送邮件工具""" 实际场景应调用SMTP API print(f"[执行] 发送邮件至{to}: {subject}") return f"邮件已发送至{to}" @staticmethod def query_database(sql: str) -> List[Dict]: """查询数据库工具""" 模拟数据库查询 return [{"id": 1, "name": "示例数据"}] ---------- 2. 极简智能体核心类 ---------- class MinimalAgent: """ 极简AI智能体实现 核心能力:规划(Planning) + 记忆(Memory) + 工具调用(Tool Use) """ def __init__(self): self.tools = ToolLibrary() 工具库 self.short_term_memory = [] 短期记忆(会话上下文) self.long_term_memory = { 长期记忆(用户偏好) "user_preferences": {} } def _plan(self, user_input: str) -> dict: """ 规划模块:将用户意图拆解为可执行的操作序列 注:完整实现需调用LLM进行意图识别与任务拆解 """ 简化版意图识别(真实场景由LLM完成) if "天气" in user_input: 提取城市(简化处理) city = "北京" if "北京" in user_input else "上海" return {"action": "get_weather", "params": {"city": city}} elif "邮件" in user_input: return {"action": "send_email", "params": {"to": "user@example.com", "subject": "AI Agent通知", "content": user_input}} else: return {"action": "chat", "params": {"message": user_input}} def _execute(self, plan: dict) -> str: """行动模块:执行规划好的操作""" action = plan.get("action") params = plan.get("params", {}) if action == "get_weather": return self.tools.get_weather(params) elif action == "send_email": return self.tools.send_email(params) elif action == "chat": return f"AI回应: {params['message']}" else: return "无法执行该操作" def _remember(self, user_input: str, response: str): """记忆模块:存储交互记录""" 短期记忆:存储最近5轮对话 self.short_term_memory.append({ "timestamp": datetime.now().isoformat(), "input": user_input, "output": response }) if len(self.short_term_memory) > 5: self.short_term_memory.pop(0) 保留最近5条 长期记忆:提取并存储用户偏好(简化版) if "喜欢" in user_input: 提取偏好关键词(真实场景需NLU模块) self.long_term_memory["user_preferences"][user_input] = True def run(self, user_input: str) -> str: """ Agent主流程:感知 → 规划 → 执行 → 记忆 """ print(f"\n[用户输入] {user_input}") Step 1: 感知 + 规划(理解意图、拆解任务) plan = self._plan(user_input) print(f"[规划结果] {plan}") Step 2: 执行行动(调用工具或生成回复) response = self._execute(plan) print(f"[执行结果] {response}") Step 3: 存储记忆 self._remember(user_input, response) return response ---------- 3. 运行示例 ---------- if __name__ == "__main__": agent = MinimalAgent() 示例1:查询天气(展示工具调用能力) agent.run("北京明天天气怎么样?") 示例2:发送邮件(展示多步操作能力) agent.run("帮我发封邮件提醒我下午开会") 示例3:展示记忆能力 agent.run("我喜欢靠窗的座位") print(f"\n[长期记忆内容] {agent.long_term_memory}")

5.1 执行流程解读

当你输入“北京明天天气怎么样?”时,Agent内部执行了如下闭环:

感知(Perception)→ 规划(Planning)→ 行动(Action)→ 观察(Observation)→ 反馈 ↓ ↓ ↓ ↓ 识别意图为 拆解为调用 调用天气API 获取结果并 将结果返回 “查天气” 天气API任务 获取数据 格式化输出 用户

这个过程被称为 ReAct模式(Reasoning + Acting)——思考与行动交替进行,直至任务完成-40。

六、底层原理:支撑AI智能体的关键技术

6.1 思维链(Chain-of-Thought,CoT)

让LLM在给出最终答案前,先展示推理步骤。例如:

用户问:明天适合户外活动吗? Agent内部思考过程: 1. 先调用天气API获取明天天气预报 2. 解析气温、降水概率、风力数据 3. 根据规则判断:气温15-25℃且降水<30%则适合 4. 得出结论:明天小雨,降水率60%,建议室内活动

2024年OpenAI发布的CoT技术推动了推理能力的发展,但至今推理能力的进步仍更多依赖外挂工具的辅助,而非模型本身的提升-6。

6.2 检索增强生成(Retrieval-Augmented Generation,RAG)

RAG让Agent能够实时检索外部知识库,避免“胡编乱造”:

用户提问 → 将问题向量化 → 从向量数据库检索相关内容 → LLM结合检索结果生成答案例如吕布AI助手回答三国历史问题时,先检索内置历史知识库,再生成准确回答-1。

6.3 模型上下文协议(Model Context Protocol,MCP)

由Anthropic提出的开源标准,被誉为 “AI时代的USB-C接口” ,统一了智能体与外部工具的连接方式-26。有了MCP,Agent可以:

通过统一协议发现可用工具

标准化获取数据、调用函数、复用模板

实现跨平台、跨框架的工具集成

6.4 底层技术依赖总结

| 上层能力 | 底层依赖技术 | 作用 |

|---|---|---|

| 规划(Planning) | 思维链(CoT)、树状思维(ToT) | 多步推理与任务拆解 |

| 记忆(Memory) | 向量数据库、RAG | 长期知识存储与精准召回 |

| 工具调用(Tool Use) | MCP协议、API网关 | 统一连接外部工具 |

| 安全控制 | 沙箱隔离、最小权限原则 | 防止越权操作-44 |

七、高频面试题与参考答案

Q1:请解释大语言模型(LLM)和AI智能体(AI Agent)的区别。

参考答案(建议背诵):

大语言模型是智能体的核心组件,负责语言理解与推理,相当于智能体的“大脑”。而AI智能体是一个完整的系统,由四大模块构成:

感知模块:接收多模态输入;

规划模块:由LLM驱动,负责任务拆解与决策;

行动模块:调用工具执行具体操作;

记忆模块:提供短期与长期记忆能力。

用公式概括:Agent = LLM + Planning + Memory + Tool Use。简单记忆:LLM会“思考”,Agent会“思考+行动+记忆”。

踩分点:答出四大模块、核心公式、功能对比缺一不可。

Q2:智能体如何处理“帮我订一张去广州的机票”这类复杂指令?

参考答案:

智能体通过规划模块将复杂目标拆解为可执行的子任务序列-2:

提取关键信息:出发地、目的地、时间偏好;

调用航班查询API获取可选航班;

根据用户历史偏好(靠窗、经济型)筛选最优选项;

调用订票API完成预订;

发送确认邮件通知用户。

整个过程遵循ReAct模式(思考-行动循环),每一步执行后观察结果,未完成则继续调整策略。

踩分点:规划拆解能力、工具调用流程、ReAct模式。

Q3:智能体的记忆系统是如何设计的?

参考答案:

智能体记忆系统采用分层架构-44:

短期记忆:存储在上下文窗口中,记录当前会话的多轮对话,一般保留最近5-10轮;

长期记忆:依托向量数据库,通过RAG(检索增强生成) 技术实现海量知识的快速检索与召回;

工作记忆:记录当前任务的中间状态,如任务进度、已执行步骤等。

三层记忆协同工作,使Agent既能理解当前对话上下文,又能记住用户的历史偏好,实现真正的个性化服务。

踩分点:三层记忆结构、RAG技术、向量数据库。

Q4:智能体在工具调用时如何保证安全性?

参考答案:

安全设计遵循 “最小权限+动态授权” 原则-44:

敏感操作(如删除文件、转账、发送邮件)必须经过用户二次确认;

所有系统调用记录至审计日志,支持事后追溯;

工具调用在沙箱环境中执行,隔离系统核心资源;

采用MCP协议统一工具接入标准,避免恶意工具注入。

切忌赋予Agent过高的资金操作权限或系统控制权,必须保留人工兜底机制。

踩分点:最小权限、二次确认、沙箱隔离、审计日志。

Q5:什么是MCP(Model Context Protocol)?为什么重要?

参考答案:

MCP(模型上下文协议)是由Anthropic提出的开源标准协议,被誉为 “AI时代的USB-C接口” -26。它解决了以往智能体连接不同工具时需要编写大量适配代码的痛点。

MCP的核心价值:

统一接入:Agent通过标准协议发现并使用各种工具(数据库、API、文件系统等);

解耦架构:工具提供方无需关心Agent的实现细节;

安全可控:协议内置权限校验与审计机制。

有了MCP,开发者只需实现一次协议接口,即可让Agent调用任意遵循该协议的工具,极大降低了智能体的开发成本。

踩分点:定义(USB-C类比)、统一接入、解耦、降低开发成本。

八、结尾总结

核心知识点回顾

| 序号 | 知识点 | 一句话总结 |

|---|---|---|

| 1 | LLM vs Agent | LLM是大脑,Agent是完整的数字员工 |

| 2 | Agent公式 | Agent = LLM + Planning + Memory + Tool Use |

| 3 | 四大模块 | 感知 → 规划 → 行动 → 记忆 |

| 4 | 核心技术 | CoT(推理)、RAG(记忆)、MCP(工具连接) |

| 5 | 安全原则 | 最小权限 + 动态授权 + 人工兜底 |

重点提示

易混淆点:不要把“调用LLM API”等同于“构建Agent”,Agent是系统级架构,LLM只是其中一个组件。

面试重点:四大模块的具体职责、ReAct工作流程、RAG与MCP的原理。

实践建议:从LangChain、AutoGen等开源框架入手,动手实现一个能调用API的简易Agent。

下期预告

下一篇:《2026智能体实战系列第2篇:多智能体协作架构——如何让多个Agent协同工作》,将深入讲解:

Manager-Worker模式的实现原理

多Agent通信协议A2A(Agent-to-Agent)

并行智能体在代码开发场景中的应用-26

💡 互动提问:在你的业务场景中,哪个环节最需要“24小时在线”的智能体?欢迎在评论区分享你的思考!